Cosa c'è di più grande di un programma di elaborazione del linguaggio naturale da 175 miliardi di parametri?

Un programma da 178 miliardi di parametri, ovviamente. Questo è solo uno degli attributi di Jurassic, un programma per computer introdotto mercoledì dalla startup di intelligenza artificiale AI21 Labs con sede a Tel Aviv.

GPT-3, ovviamente, è il programma linguistico dell'azienda con sede a San Francisco. startup OpenAI che ha scosso il mondo nel 2020 generando frasi e interi articoli che sembravano piuttosto umani. GPT-3 ha anche scioccato il mondo essendo stato tenuto all'interno di un accordo di beta testing abbastanza restrittivo da OpenAI.

AI21 promette di diventare OpenAI non uno migliore, ma due migliori, con quelli che afferma essere risultati di benchmark superiori su un test noto come “apprendimento a pochi colpi” e un programma più aperto per i beta tester.

Su quest'ultimo punto, AI21 sta rendendo l'uso dello sviluppo del programma disponibile come “open beta”, ha detto, dove chiunque può registrarsi per utilizzare il programma e non c'è “nessuna lista di attesa”.< /p>

Tuttavia, la quantità di testo generato è limitata nel modello beta. Per distribuire un codice di qualità di produzione in grado di fornire previsioni su richiesta, le parti devono presentare una domanda per un servizio di livello commerciale ed essere approvate da AI21.

Si utilizza quindi il programma di sviluppo di AI21, AI21 Studio, per sviluppare e distribuire modelli linguistici personalizzati.

La startup, il cui nome sta per “AI for the 21st Century”, ha alcuni pezzi grossi tra il suo staff esecutivo e consulenti .

Inoltre: Che cos'è GPT-3? Tutto ciò che la tua azienda ha bisogno di sapere sull'innovativo programma linguistico AI di OpenAI

I fondatori sono il professore della Stanford University Yoav Shoham, che ricopre il ruolo di co-CEO; l'imprenditore seriale Ori Goshen, l'altro CEO; e Amnon Shashua, che è il CEO dell'unità Mobileye di Intel che produce chip per auto a guida autonoma, e che è anche professore di informatica presso l'Università Ebraica di Gerusalemme e ha molti progetti di ricerca sull'apprendimento automatico al suo nome.

I consulenti includono Sebastian Thrun, un pioniere dei veicoli autonomi, e Chris Ré, professore della Stanford University e co-fondatore del produttore di computer AI SambaNova Systems.

AI21 ha ricevuto 35,4 milioni di dollari in due round di finanziamento di rischio.

Oltre al comunicato stampa, AI21 ha pubblicato un white paper che descrive l'architettura di Jurassic e i risultati del benchmark rispetto a GPT-3. Quel documento è stato scritto dal co-CEO Shoham, insieme ai membri dello staff di AI21 Opher Lieber, Or Sharir e Barak Lenz.

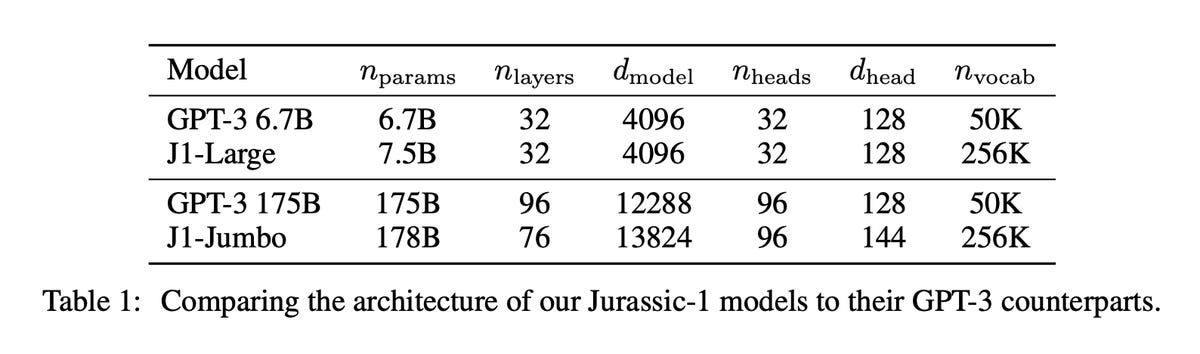

Il documento descrive in dettaglio l'architettura di Jurassic, la sua disposizione dei diversi elementi funzionali. Per molti aspetti, Jurassic sta copiando ciò che OpenAI ha fatto in GPT-3, con una svolta fondamentale.

La partenza è stata resa possibile da un'intuizione teorica portata da Shashua e dai colleghi della Hebrew University, presentata alla conferenza Neurips AI dello scorso anno.

Questa ricerca, condotta da Yoav Levine, insieme a Shashua, Noam Wies, Or Sharir e Hofit Bata, sostiene che esiste un importante compromesso nelle reti neurali tra quella che viene chiamata larghezza e profondità.

La profondità della rete neurale è il numero di strati di neuroni artificiali attraverso i quali un dato dato di input viene elaborato in sequenza. Il fulcro delle forme di “apprendimento profondo” dell'IA sono molti più livelli, quindi una maggiore profondità. Il GPT-3 di OpenAI, nella sua forma “canonica”, con 175 miliardi di parametri, ha una profondità di 96 livelli.

Larghezza, al contrario , è la dimensione del vettore che memorizza una rappresentazione di un input. Per GPT-3, questo è tipicamente un vettore di dimensioni di 12.288.

Nella ricerca di Levine e del team, hanno scoperto che troppi livelli possono portare a risultati decrescenti per un programma di apprendimento profondo del tipo “auto-attenzione”, che è ciò che è GPT-3, e tutti i programmi del genere sono tutti costruiti sull'originale Programma Transformer di Google.

Come lo definiscono, “per una data dimensione di rete”, ovvero il numero di parametri, “una certa rete può essere troppo superficiale, come abbiamo previsto teoricamente e confermato empiricamente sopra, ma può anche essere troppo profondo.” Quindi, Levine e il team concludono che il loro è un equilibrio ottimale profondità-ampiezza nella costruzione di un programma in linguaggio naturale.

È questa intuizione che Shoham e colleghi di AI21 dettagliano nel loro articolo. “Per un dato budget di parametro c'è una profondità ottimale.” Nello specifico, sostituiscono i 96 livelli di GPT-3 con solo 76 livelli e sostituiscono la larghezza del vettore di GPT-3 di 12.288 con una larghezza di 13.824.

Anche: AI in sessanta secondi

Secondo la ricerca di Levine, questo dovrebbe in definitiva dare a Jurassic quella che viene chiamata una maggiore “espressività”, che dovrebbe essere la qualità della sua produzione linguistica. Tuttavia, ciò che i ricercatori di AI21 osservano è “un significativo guadagno nelle prestazioni di runtime” quando si esegue il loro programma su una GPU rispetto a GPT-3:

Spostando le risorse di calcolo dalla profondità alla larghezza, è possibile eseguire più operazioni in parallelo (larghezza) anziché in sequenza (profondità). Ciò è particolarmente rilevante per la generazione di testo in cui i token vengono elaborati uno alla volta e quindi ci sono meno opportunità per la parallelizzazione, con conseguente utilizzo della GPU non ottimale. Nei nostri benchmark, confrontando la nostra architettura con GPT-3 175B sulla stessa configurazione hardware, la nostra architettura ha vantaggi modesti nel tempo di addestramento (accelerazione dell'1,5% per iterazione), ma guadagni significativi di runtime nell'inferenza batch (7%) e nella generazione di testo (26 %).

Un'altra cosa che Shoham e il team hanno fatto con Jurassic è stata aumentare la dimensione del vocabolario, il numero di token unici che il programma può ingerire e tenere traccia, dai 50.000 utilizzati da GPT-3 a 256.000. Sono anche andati oltre l'uso di token come semplici parole per utilizzare “elementi di vocabolario”, come li chiamano, in cui le unità “contengono una ricca miscela di pezzi di parole, parole intere ed espressioni di più parole”.

Citando ancora una volta il lavoro di Levine e del team, i ricercatori di AI21 sostengono che un uso così flessibile dei token è “più strettamente allineato con le unità semantiche del testo, comprese sia le entità nominate che le frasi comuni”, e quindi offre “diversi vantaggi, come formazione più efficiente per il campione.”

I numerosi vantaggi includono quello che sembra essere un grande impulso nell'esecuzione dei test rispetto a GPT-3. Forniscono dati che affermano che i 178 miliardi di parametri di Jurassic sono paragonabili in termini di accuratezza a GPT-3 in quelle che vengono chiamate attività “zero-shot”, in cui non viene fornito alcun esempio di scrittura umana al momento del test del programma.

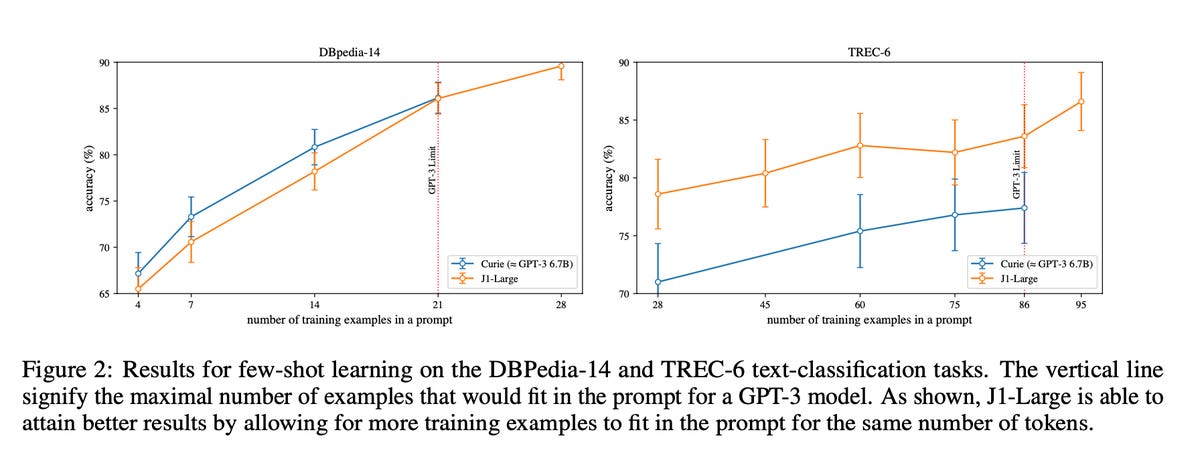

L'obiettivo principale di Shoham e del team, tuttavia, è dove il GPT-3 eccelle particolarmente, ovvero i test noti come “apprendimento a breve termine”, in cui diversi esempi vengono prima digitati da una persona e il programma linguistico produce output sostanzialmente continuando il modello di quegli esempi.

Pensa al vecchio gioco delle analogie, “Microsoft sta ai computer desktop come Apple sta ai telefoni e Burger King sta agli hamburger come Kentucky Fried Chicken sta a ______”, e il programma linguistico deve capire che tipo di risposta viene chiesto per nel vuoto in base al modello di relazioni. Sono pochi colpi e può essere fatto per molti tipi di attività, tra cui la risposta alle domande sì-no e la risposta alle domande a scelta multipla.

Qui, gli autori rivendicano i vantaggi di un uso più flessibile dei token. “Uno dei suoi vantaggi è che in contesti di apprendimento di poche riprese possono adattarsi al prompt più esempi di formazione”. Di conseguenza, con lo stesso numero complessivo di esempi di addestramento di GPT-3, rivendicano una maggiore precisione, in particolare perché più esempi possono adattarsi al prompt.

Nonostante affermando che quelli che credono siano risultati superiori, Shoham e il team nota in anticipo che “la valutazione dell'apprendimento a breve termine è notoriamente complicata, essendo soggetta ai capricci della scelta rapida”.

Quindi, Shoham e il team hanno sviluppato una suite di test per affrontare tali sfide nel modo in cui i modelli molto grandi vengono confrontati l'uno con l'altro. Hanno pubblicato quel codice su GitHub.

Mentre i risultati dei test saranno probabilmente esaminati in molti modi diversi mentre le persone calciano le gomme, l'obiettivo più grande di AI21 sembra essere quello di aver costruito un GPT-3 più accessibile dall'altra parte del muro OpenAI , per sfruttare, come azienda, il desiderio di molti utenti di accedere alla capacità.

da leggere

Etica dell'IA: vantaggi e rischi dell'intelligenza artificiale

La scala crescente dell'IA sta alzando la posta in gioco per importanti questioni etiche.

Ulteriori informazioni

Argomenti correlati:

Developer Digital Transformation CXO Internet of Things Innovation Enterprise Software ![]()

Di Tiernan Ray | 11 agosto 2021 — 15:21 GMT (16:21 BST) | Argomento: Intelligenza artificiale