< /p > Billede: Apple

Da Apple annoncerede sine planer om at tackle materiale til misbrug af børn på sine operativsystemer i sidste uge, sagde det, at tærsklen, det satte for falske positive kontodeaktiveringer, ville være én ud af en billion om året.

Nogle af funktionerne i, hvordan Apple nåede frem til dette nummer, blev afsløret i et dokument [PDF], der gav flere detaljer om systemet.

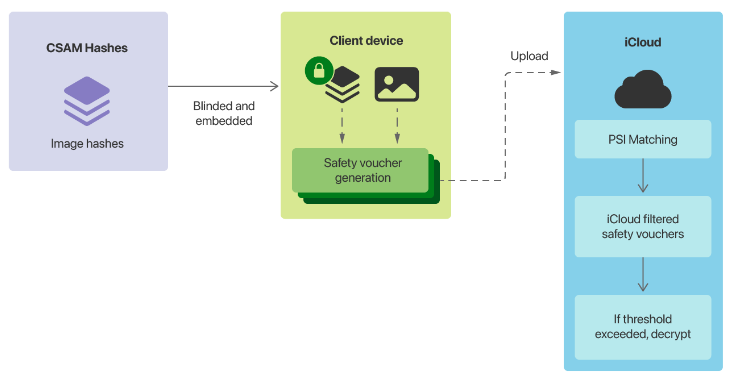

Den mest omstridte komponent i Cupertinos planer var dets system til registrering af seksuelt misbrug af børn (CSAM). Det vil omfatte Apple -enheder, der matcher billeder på enheden i forhold til en liste over kendte CSAM -billedhashes, der leveres af US National Center for Missing and Exploited Children (NCMEC) og andre børnesikkerhedsorganisationer, før et billede gemmes i iCloud.

Når en rapporteringstærskel er nået, vil Apple inspicere metadata, der uploades sammen med de krypterede billeder i iCloud, og hvis virksomheden fastslår, at det er CSAM, deaktiveres brugerens konto og indholdet overdrages til NCMEC i USA.

Dokumentet angiver, at CSAM -hash, Apple brugte, ville være skæringspunktet mellem to samlinger fra to børnesikkerhedsorganisationer, der opererer i forskellige lande.

“Enhver perceptuel hash, der kun forekommer i én deltagende børnesikkerhedsorganisations database eller kun i databaser fra flere agenturer i en enkelt suveræn jurisdiktion, kasseres af denne proces og er ikke inkluderet i den krypterede CSAM -database, som Apple inkluderer i operativsystemet,” står der i dokumentet.

Efter at have kørt hash mod 100 millioner ikke-CSAM-billeder fandt Apple tre falske positiver og nul, når det blev kørt mod en samling voksenpornografi. Virksomheden sagde under antagelse af en “worst-case” fejlprocent på en ud af en million, at den ønskede en rapporteringstærskel for at sikre sin one-in-a-billion falske positive deaktiveringstærskel.

“Ved at bygge en ekstra sikkerhedsmargin op ved at antage, at hvert iCloud -fotobibliotek er større end det egentlige største, forventer vi at vælge en indledende matchterskel på 30 billeder,” hedder det.

“Da denne indledende tærskel indeholder en drastisk sikkerhedsmargen, der afspejler en værst tænkelig antagelse om virkelige præstationer, kan vi ændre tærsklen efter fortsat empirisk evaluering af NeuralHash falsk-positive satser-men matchtersklen vil aldrig være lavere end hvad der er påkrævet for at producere en en-i-en-billion billioner falsk positiv sats for en given konto. ”

For at sikre, at Apples iCloud -servere ikke vedligeholder antallet af positive CSAM -billeder, en bruger har, vil deres enhed også producere falske metadata, som Apple kalder sikkerhedskuponer. Apple sagde, at dets servere ikke vil kunne skelne rigtige værdikuponer fra de falske, før tærsklen er nået.

“Matchningsprocessen på enheden vil med en vis sandsynlighed erstatte en reel sikkerhedskupon, der genereres med en syntetisk værdikupon, der kun indeholder støj. Denne sandsynlighed er kalibreret for at sikre, at det samlede antal syntetiske værdikuponer er proportionalt med kampgrænsen, “Sagde Apple.

“Vigtigst er disse syntetiske værdikuponer en ejendom for hver konto, ikke for systemet som helhed. For konti under matchgrænsen ved kun brugerens enhed, hvilke bilag der er syntetiske; Apples servere gør det ikke og kan ikke bestemme dette tal og kan derfor ikke tælle antallet af ægte positive kampe. ”

Apple bekræftede også, at metadataene ville indeholde en lavopløselig kopi af billederne til menneskelig inspektion, og disse kopier køres også mod CSAM-hash.

“Denne uafhængige hash vælges for at afvise den usandsynlige mulighed for, at kampgrænsen blev overskredet på grund af ikke-CSAM-billeder, der blev forstyrret adversivt for at forårsage falske NeuralHash-kampe mod den på enheden krypterede CSAM-database,” Apple sagde.

“Hvis CSAM -fundet bekræftes af denne uafhængige hash, leveres de visuelle derivater til Apples menneskelige korrekturlæsere til endelig bekræftelse.”

Cupertino sagde, at systemet var designet, så en bruger ikke behøver at stole på, at Apple ved, at systemet “fungerer som annonceret”.

“Trusselmodellen er afhængig af systemets tekniske egenskaber for at beskytte sig mod den usandsynlige mulighed for ondsindede eller tvungne korrekturlæsere og afhænger igen af korrekturlæserne for at beskytte sig mod muligheden for tekniske eller menneskelige fejl tidligere i systemet,” sagde Apple.

Virksomheden fastholdt, at den menneskelige inspektionsproces ville sikre, at hvis ikke-CSAM-hash blev tilføjet til rapporteringssættet, at materialet ikke ville blive videregivet fra Apple.

“Anmelderne bekræfter kun en ting: At for en konto, der overskred matchgrænsen, har de positivt matchende billeder visuelle derivater, der er CSAM,” stod der.

“Det betyder, at hvis ikke-CSAM-billeder nogensinde blev indsat i enhedens perceptuelle CSAM-hashdatabase-utilsigtet eller ved tvang-ville der ikke være nogen effekt, medmindre Apples menneskelige korrekturlæsere også blev informeret om, hvilke specifikke ikke-CSAM-billeder de skulle flag (for konti, der overstiger matchgrænsen), og blev derefter tvunget til at gøre det. ”

Firmaet gentog, at det ville afvise anmodninger om at tilføje ikke-CSAM-billeder til datasættet.

“Apple vil også afvise alle anmodninger om at instruere menneskelige korrekturlæsere til at indgive rapporter om andet end CSAM -materiale til konti, der overstiger matchgrænsen,” hed det.

Da det offentliggjorde den første meddelelse, meddelte Apple også, at maskinlæring ville blive brugt inden for iMessage til at advare forældre ved hjælp af familiedeling, når børnekonti har set eller sendt seksuelt eksplicitte billeder samt give advarsler til barnet.

“For børnekonti på 12 år og yngre vil hver forekomst af et seksuelt eksplicit billede, der sendes eller modtages, advare barnet om, at hvis det fortsætter med at se eller sende billedet, får deres forældre en underretning. Kun hvis barnet fortsætter med at sende eller visning af et billede efter denne advarsel, vil meddelelsen blive sendt, “sagde Apple tidligere.

“For børnekonti i alderen 13-17 år advares barnet stadig og bliver spurgt, om det ønsker at se eller dele et seksuelt eksplicit billede, men forældre underrettes ikke.”

I sit dokument sagde Apple, at funktionen ikke kan aktiveres for voksne konti og ikke er aktiveret som standard.

Om spørgsmålet om falske positiver stod der for børn i alderen 13 til 17 år, hvis et billede er kategoriseret forkert, og et barn ser det, ville de se noget, der ikke er eksplicit. For dem under 13 år kan det indebære forældresyn.

“For et barn under 13 år, hvis konto er tilmeldt funktionen, og hvis forældre valgte at modtage notifikationer for funktionen, sender barnet et modsatbillede eller et, der godartet udløser en falsk positiv klassificering, betyder, at hvis de beslutter for at fortsætte begge advarsler, vil de se noget, der ikke er seksuelt eksplicit, og der vil blive sendt en meddelelse til deres forældre, “sagde Apple.

“Fordi det foto, der udløste meddelelsen, bevares på barnets enhed, kan deres forældre bekræfte, at billedet ikke var seksuelt eksplicit.”

Apple sagde også, at det har overvejet spørgsmålet om, at en voksen blev tvunget til en konto som barn under 13 år, men ikke gav en anden løsning end at oplyse, at hvis man ikke ser billederne, ikke ville få advarsler til at blive sendt .

“Hvis funktionen blev aktiveret skjult eller ondsindet – for eksempel i trusselmodellen Intimate Partner Surveillance ved at tvinge en bruger til at deltage i Family Sharing med en konto, der er konfigureret til at tilhøre et barn under 13 år – brugeren ville modtage en advarsel, når de prøver at se eller sende et seksuelt eksplicit billede, “stod der.

“Hvis de valgte at fortsætte, ville de få en anden advarsel, der lader dem vide, at visning af billedet vil resultere i, at der sendes en meddelelse og give dem et andet valg om, hvorvidt de skal fortsætte. Hvis de afviste at fortsætte, hverken det faktum, at advarsler blev præsenteret, eller brugerens beslutning om at annullere, sendes til nogen. ”

Relateret dækning

Apples scanning af materiale til misbrug af børn i iOS 15 trækker ild Appel afviser regeringens krav om at udvide scanning ud over børnemishandlingUS Bill introduceret for at bremse 'big tech mobning' i app store -rummet Forskere opdager ny AdLoad malware -kampagner rettet mod Mac'er og Apple -produkter

Relaterede emner:

Apple Security TV Data Management CXO -datacentre