< p class="meta"> Door Chris Duckett | 23 augustus 2021 — 04:48 GMT (05:48 BST) | Onderwerp: Hardware

Afbeelding: IBM

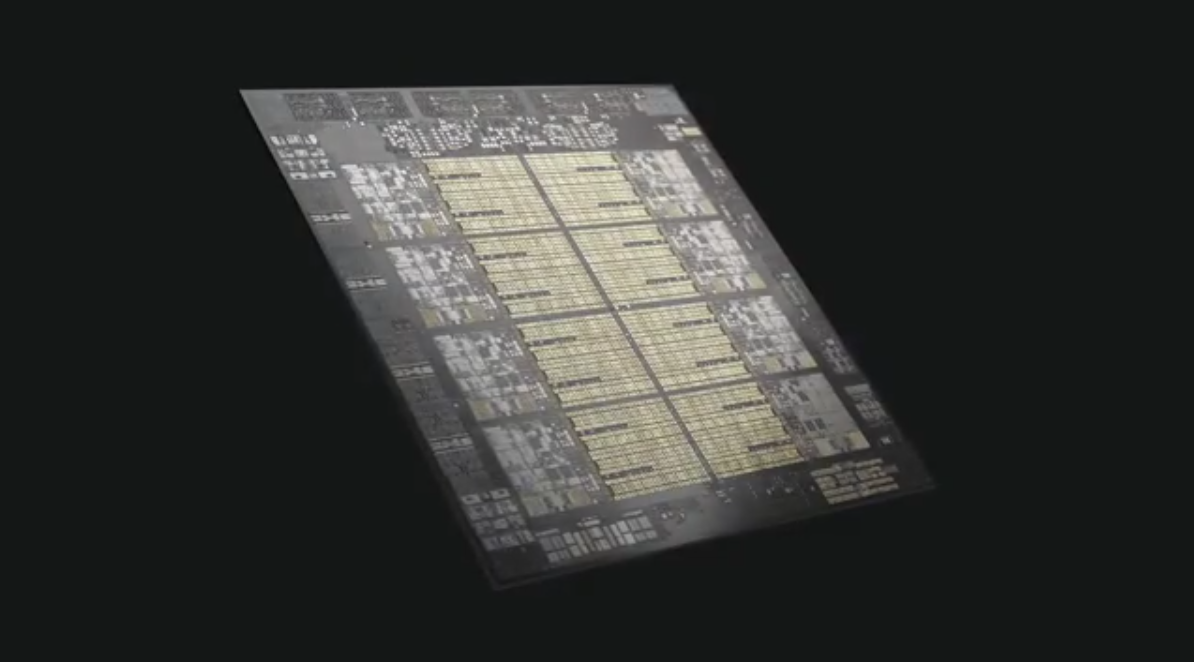

Big Blue heeft Telum onthuld, de eerste chip met AI-inferentieversnelling waarmee het taken zoals fraudedetectie kan uitvoeren terwijl een transactie plaatsvindt.

“De chip bevat 8 processorkernen met een diepe superscalaire out-of-order instructiepijplijn, draaiend met een klokfrequentie van meer dan 5GHz, geoptimaliseerd voor de eisen van heterogene enterprise-class workloads”, aldus IBM.

“De volledig opnieuw ontworpen cache- en chip-interconnectie-infrastructuur biedt 32 MB cache per core en kan worden geschaald tot 32 Telum-chips. Het dual-chip moduleontwerp bevat 22 miljard transistors en 19 mijl draad op 17 metalen lagen .”

De chip is gebouwd op 7nm-technologie voor extreem ultraviolet, ontwikkeld door Samsung, en vertegenwoordigt de initiële betrokkenheid van het IBM Research AI Hardware Center.

In ontwikkeling voor drie jaar, is het eerste systeem dat de chip gebruikt, gepland voor de eerste half 2022.

Senior technisch personeelslid voor IBM Z-hardwareontwikkeling Anthony Saporito zei dat de L2-caches kunnen worden gecombineerd en een virtuele 256 MB L3-cache vormen, en dat maximaal acht Telum-chips kunnen worden gecombineerd om een virtuele 2 GB L4 te vormen cache.

“Een van de belangrijkste innovaties hier op het Telum-ontwerp is dat we een AI-versneller rechtstreeks op het silicium van de chip hebben gebouwd en we hebben alle kernen rechtstreeks met elkaar verbonden en een ecosysteem op de stapel gebouwd, via het hardwareontwerp, via firmware en via de besturingssystemen en de software die het mogelijk maakt om dit diepgaande leren in transacties te brengen, alle transacties”, zei hij.

“Dat deel van het ontwerp is een echt cool samenwerkingsontwerp dat we hebben gemaakt tussen de onderzoeksgroep en de systeemgroep, en dat direct verbonden ontwerp dat is gebouwd voor diep leren inferentie stelt ons in staat om op schaal te werken.

” p>

“Die duizenden en duizenden transacties per seconde … met deze technologie zijn in staat om real-time deep learning-inferentie, fraudedetectie en analyses uit te voeren en inzichten te verkrijgen terwijl die transacties op het systeem worden uitgevoerd en ze zijn in staat om dat te doen op schaal en met alle betrouwbaarheid en nul downtime, dat is van cruciaal belang voor dit platform.”

In mei creëerde IBM Research een testhalfgeleider met 2nm-fabricage waarvan Big Blue beweerde dat deze de prestaties met 45% zou verbeteren met dezelfde hoeveelheid stroom of 75% minder energie zou verbruiken in vergelijking met 7nm-gebaseerde chips.

De 2nm-technologie zal tegen het einde van 2024 in productie gaan. Massaal gebruik zou rond 2025 kunnen plaatsvinden.

“Dit is opwindend omdat de meest geavanceerde productie ter wereld zich op ongeveer 7nm bevindt en sommige op 5mn, en we zijn hier om te laten zien dat we een 2nm-transistor kunnen samenstellen. Dat betekent dat deze industrie het komende decennium zal doorgaan, dat is wat deze resultaten betekenen”, zei IBM Research vice-president Mukesh Khare destijds.

Gerelateerde dekking

IBM en Michael J. Fox Foundation gebruiken AI om symptoomprogressie voor Parkinson te lokaliseren IBM vindt ASX-storing als gevolg van handelsplatform dat niet klaar is voor go-liveIBM, SAP-partner om te verhuizen financiële instellingen naar de hybride cloudLinux Foundation, IBM, Samsung en Prometeo bundelen hun krachten voor een zorgproject voor brandweerlieden IBM's nieuwste kwantumcomputer is nu in de lucht: dit is waar het voor gaat worden gebruikt IBM en CERN gebruiken kwantumcomputing om op het ongrijpbare Higgs-deeltje te jagen

Verwante onderwerpen:

PC's Servers Opslag Netwerken Datacenters ![]()