Af Chris Duckett | 9. august 2021 – 00:49 GMT (01:49 BST) | Emne: Sikkerhed

Billede: Apple

Fredag afslørede Apple planer om at tackle spørgsmålet om børnemishandling på sine operativsystemer i USA via opdateringer til iOS 15, iPadOS 15, watchOS 8 og macOS Monterey.

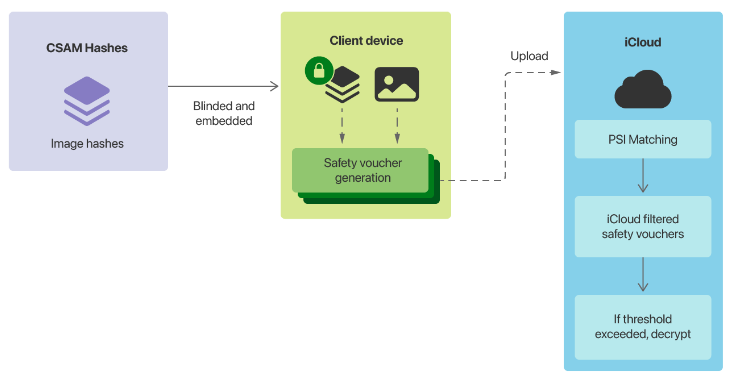

Den mest omstridte komponent i Cupertinos planer er dets materiale til registrering af seksuelt misbrug af børn (CSAM). Det vil omfatte Apple -enheder, der matcher billeder på enheden i forhold til en liste over kendte CSAM -billedhashes, der leveres af US National Center for Missing and Exploited Children (NCMEC) og andre børnesikkerhedsorganisationer, før et billede gemmes i iCloud.

“Inden et billede gemmes i iCloud-fotos, udføres der en matchningsproces på enheden for dette billede mod de kendte CSAM-hash. Denne matchingsproces drives af en kryptografisk teknologi kaldet private set-skæringspunkt, som afgør, om der er et match uden at afsløre resultatet, “sagde Apple.

“Enheden opretter en kryptografisk sikkerhedskupon, der koder matchresultatet sammen med yderligere krypterede data om billedet. Denne værdikupon uploades til iCloud -fotos sammen med billedet.”

Når en uangivet tærskel er nået, vil Apple manuelt se på bilagene og gennemgå metadataene. Hvis virksomheden fastslår, at det er CSAM, deaktiveres kontoen, og en rapport sendes til NCMEC. Cupertino sagde, at brugerne vil kunne appellere til at få en konto genaktiveret.

Apple hævder, at dens tærskel vil sikre “mindre end en i en billion bil om året for forkert at markere en given konto”.

Det andet par funktioner, Apple annoncerede fredag, havde Siri og søgning, der giver advarsler, når en bruger søger efter CSAM-relateret indhold og bruger maskinlæring til at advare børn, når de skal se seksuelt eksplicitte fotos i iMessages.

“Når du modtager denne type indhold, bliver billedet sløret, og barnet vil blive advaret, præsenteret med nyttige ressourcer og forsikret om, at det er i orden, hvis de ikke vil se dette foto. Som en ekstra sikkerhedsforanstaltning kan barnet også fortalte, at for at sikre, at de er i sikkerhed, får deres forældre en besked, hvis de ser det, “sagde Apple.

“Lignende beskyttelse er tilgængelig, hvis et barn forsøger at sende seksuelt eksplicitte billeder. Barnet vil blive advaret, før billedet sendes, og forældrene kan modtage en besked, hvis barnet vælger at sende det.”

Billede: Apple

Planer mærket som bagdør

Apples planer vakte kritik i weekenden, hvor Electronic Frontier Foundation mærkede funktionerne som en bagdør.

“Hvis du har brugt nogen tid på at følge Crypto Wars, ved du, hvad det betyder: Apple planlægger at bygge en bagdør ind i sit datalagringssystem og sit messaging -system,” skrev EFF.

“Apple kan i længden forklare, hvordan dets tekniske implementering vil bevare privatlivets fred og sikkerhed i den foreslåede bagdør, men i sidste ende er selv en grundigt dokumenteret, omhyggeligt gennemtænkt og snævert dækket bagdør stadig en bagdør.”

EFF advarede om, at når CSAM -systemet var på plads, ville det næste trin være at ændre systemet til at søge efter andre former for indhold.

“Det er ikke en glat skråning; det er et fuldt bygget system, der bare venter på, at eksternt pres skal foretage den mindste ændring,” hed det.

“Misbrugssagerne er lette at forestille sig: regeringer, der forbyr homoseksualitet, kan kræve, at klassifikatoren oplæres i at begrænse tilsyneladende LGBTQ+ -indhold, eller et autoritært regime kan kræve, at klassifikatoren kan se populære satiriske billeder eller protestflyveblad.”

EFF tilføjede, at med iMessage til at begynde at scanne billeder, der blev sendt og modtaget, var kommunikationsplatformen ikke længere end-to-end krypteret.

“Apple og dets tilhængere kan hævde, at scanning før eller efter en besked er krypteret eller dekrypteret holder løftet fra ende til ende intakt, men det ville være semantisk manøvrering for at dække over et tektonisk skift i virksomhedens holdning til stærk kryptering, “sagde fonden.

Leder af WhatsApp Will Cathcart sagde, at den Facebook-ejede platform ikke ville vedtage Apples tilgang og i stedet ville stole på, at brugerne rapporterede materiale.

“Dette er et Apple -bygget og drevet overvågningssystem, der meget let kan bruges til at scanne privat indhold for alt, hvad de eller en regering beslutter, at det vil kontrollere. Lande, hvor iPhones sælges, vil have forskellige definitioner på, hvad der er acceptabelt,” sagde Cathcart.

WhatsApp -chefen spurgte, hvordan systemet ville fungere i Kina, og hvad ville der ske, når et spyware -besætning fandt ud af, hvordan systemet kunne udnyttes.

WhatsApp scanner ikke -krypterede billeder – f.eks. profil- og gruppebilleder – efter børnemishandlingsmateriale.

“Vi har yderligere teknologi til at opdage nyt, ukendt CEI inden for denne ukrypterede information. Vi bruger også maskinlæringsklassifikatorer til både at scanne tekstoverflader, f.eks. Brugerprofiler og gruppebeskrivelser, og evaluere gruppeoplysninger og adfærd ved mistanke om CEI -deling,” siger virksomheden. sagde.

Den tidligere Facebook CSO Alex Stamos sagde, at han var glad for at se Apple tage ansvar for virkningerne af sin platform, men satte spørgsmålstegn ved tilgangen.

“De flyttede begge bolden fremad teknisk set og skadede den samlede indsats for at finde politisk balance,” sagde Stamos.

“Et af de grundlæggende problemer med Apples tilgang er, at de virker desperate efter at undgå at opbygge en reel tillids- og sikkerhedsfunktion for deres kommunikationsprodukter. Der er ingen mekanisme til at rapportere spam, dødstrusler, hadefulde ytringer, NCII eller andre former for misbrug på iMessage. ”

I stedet for sin “ikke-konsensus-scanning af lokale fotos og oprettelse af ML på klientsiden, der ikke vil give en masse reel forebyggelse af skader”, sagde Stamos, at han ville have foretrukket, hvis Apple havde robust rapportering i iMessage, bemandet et børnesikkerhedsteam at undersøge rapporter og langsomt udrullet maskinlæring på klientsiden. Den tidligere Facebook-sikkerhedschef sagde, at han frygtede, at Apple havde forgiftet brønden på klassifikatorer på klientsiden.

“Mens Kina er blevet påberåbt meget, forventer jeg, at UK Online Safety Bill og EU Digital Services Act var meget vigtigere for Apples overvejelser,” sagde han.

Whistleblower Edward Snowden anklagede Apple for at have indsat masseovervågning rundt om i verden.

“Tag ikke fejl: Hvis de kan scanne efter børneporno i dag, kan de scanne efter alt i morgen,” sagde han.

“De forvandlede en billion dollars af enheder til iNarcs -*uden at spørge.*”

Sent på fredag rapporterede 9to5Mac om et internt notat fra Apple, der indeholdt en note fra NCMEC.

“Vi ved, at de kommende dage vil blive fyldt med mindretallets skrigende stemmer,” sagde NCMEC angiveligt.

Relateret dækning

Hvorfor ser det ud til, at Apple foretager så mange dårlige designvalg? Hvorfor vil du måske ikke købe en ny iPhone før i 2022 Stop med at ignorere denne iPhone -advarsel Apple FYQ3 knuser forventningerne: 81,4 milliarder dollars omsætning, $ 1,30 EPS; aktier sag

Relaterede emner:

Apple Security TV Data Management CXO Data Centers ![]()