Kulynych ha ottenuto il premio più alto grazie alla sua scoperta che l'algoritmo di Twitter tende ad applicare un “filtro di bellezza”.

Immagine: Bogdan Kulynych

Twitter ha sperimentato un metodo senza precedenti per trovare i pregiudizi nascosti nei propri algoritmi.

La piattaforma di social media ha arruolato ricercatori esterni in un concorso unico nel suo genere, in cui i partecipanti vincitori sono stati quelli che sono riusciti a fornire le prove più convincenti che dimostrano una pratica sleale eseguita da uno degli algoritmi dell'azienda.

Denominata “sfida algorithmic bias bounty”, l'iniziativa ha fornito ai partecipanti pieno accesso al codice che sta alla base dell'algoritmo di ritaglio delle immagini di Twitter, che determina come devono essere ritagliate le immagini per essere facilmente visualizzate quando si presentano su la cronologia di un utente.

VEDERE: Il Pentagono afferma che la sua nuova intelligenza artificiale può vedere gli eventi “giorni in anticipo”

Il modello è programmato per stimare ciò che è più probabile che una persona voglia guardare in un'immagine, ovvero la parte più saliente dell'immagine, motivo per cui è noto anche come algoritmo di salienza. L'obiettivo della sfida era scoprire se l'algoritmo di salienza compie scelte dannose o discriminatorie, con la promessa di vincere premi che vanno da $ 500 a $ 3.500.

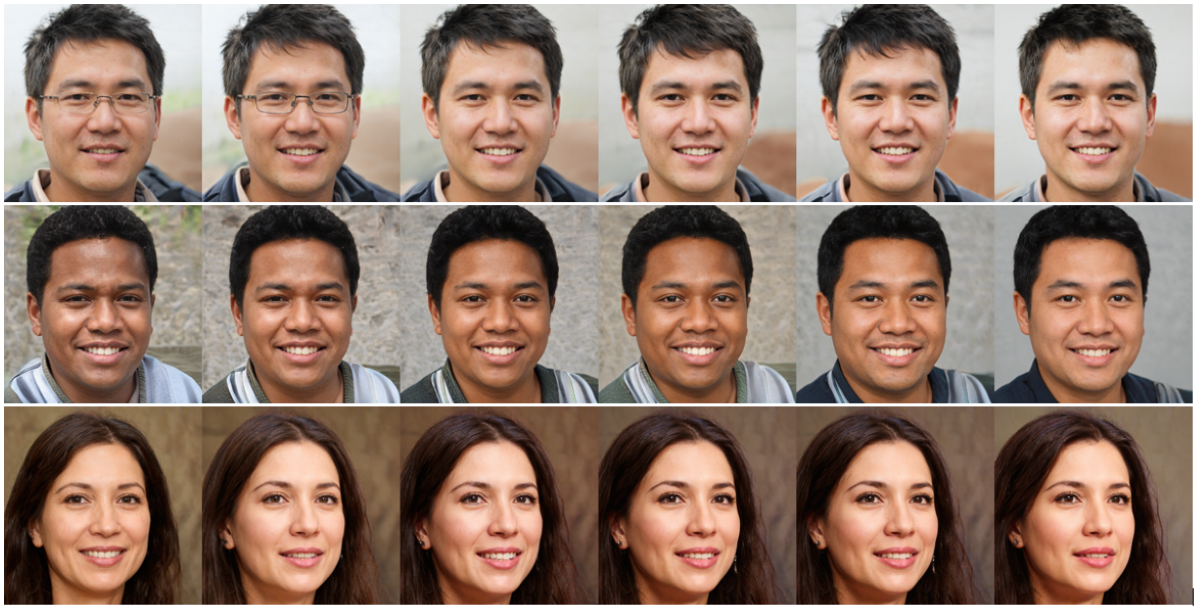

Lo studente di ingegneria della sicurezza e della privacy Bogdan Kulynych si è aggiudicato il primo premio. Il ricercatore ha scoperto che l'algoritmo tende ad applicare un “filtro di bellezza”: favorisce i volti più snelli e più giovani, nonché quelli con un colore della pelle chiaro o caldo e una consistenza della pelle liscia e caratteristiche del viso stereotipicamente femminili.

“Ho visto l'annuncio su Twitter e sembrava vicino ai miei interessi di ricerca: attualmente sono uno studente di dottorato e mi concentro su privacy, sicurezza, apprendimento automatico e su come si intersecano con la società”, Kulynych dice a ZDNet. “Ho deciso di partecipare e sono riuscito a mettere su qualcosa in una settimana”.

Non è una novità che l'algoritmo di salienza di Twitter sia problematico. L'anno scorso, gli utenti della piattaforma hanno iniziato a notare che la tecnologia tendeva a scegliere i bianchi rispetto ai neri durante il ritaglio, così come i volti maschili rispetto ai volti femminili. Dopo aver condotto alcune ricerche in proprio, l'azienda ha ammesso che il modello ha fatto scelte sleali e ha rimosso del tutto l'algoritmo di salienza, lanciando invece un nuovo modo per visualizzare per intero le foto con proporzioni standard.

Ma invece di mettere definitivamente da parte l'algoritmo, Twitter ha deciso di mettere a disposizione dei ricercatori il codice del modello per vedere se potrebbero emergere altre pratiche dannose.

Se l'idea ricorda i programmi di bug bounty che ora sono la norma nel settore della sicurezza, è perché il concetto si basa esattamente sulla stessa cosa.

Nella sicurezza, i bug bonus vedono le aziende che chiedono agli esperti di sicurezza di aiutarli a identificare le vulnerabilità nei loro prodotti prima che gli hacker possano sfruttarli a loro vantaggio. E nel campo dell'IA, gli esperti hanno pensato a lungo di trasporre il concetto per rilevare i bias negli algoritmi.

Twitter è la prima azienda ad aver trasformato il concetto in un'iniziativa di vita reale e, secondo Kulynych, il metodo promette bene.

“Siamo riusciti a creare qualcosa in un periodo di tempo molto breve”, dice Kulynych a ZDNet. “Naturalmente, il ritmo veloce significa che esiste la possibilità di un falso positivo. Ma intrinsecamente è una buona cosa perché ti incentiva a far emergere il maggior numero possibile di danni, il prima possibile”.

Ciò contrasta con il modo in cui gli accademici hanno cercato finora di dimostrare pregiudizi e danni algoritmici. Soprattutto durante l'audit dei modelli di un'azienda esterna, questo processo può richiedere mesi o addirittura anni, in parte perché i ricercatori non hanno accesso al codice dell'algoritmo. L'algoritmo di bias bounty challenge, d'altra parte, è un'iniziativa guidata da Twitter, il che significa che la società ha aperto l'accesso al codice del modello ai partecipanti che desiderano indagare.

VEDI: L'intelligenza artificiale può migliorare le tue linee di ritiro?

È importante sottolineare che la sfida della piattaforma di social media è stata il primo test nella vita reale di un concetto che finora è esistito principalmente nell'immaginazione di coloro che studiano l'IA etica. E come per la maggior parte delle idee astratte, uno dei principali punti critici era che non esiste una metodologia per i premi di distorsione algoritmica. A differenza dei bug di sicurezza, che hanno protocolli, regole e standard consolidati, non esistono best practice quando si tratta di rilevare i bias nell'IA.

Twitter ha quindi prodotto una prima nel settore, con una guida e una metodologia approfondite per la sfida che i partecipanti devono seguire quando cercano di identificare potenziali danni che l'algoritmo di salienza potrebbe introdurre – e inizia con la definizione esatta ciò che costituisce un danno.

“Nella descrizione della competizione, c'era una tassonomia dei danni che è stata davvero utile e piuttosto sfumata”, afferma Kulynych. “Era persino più ampio delle nozioni tradizionali di pregiudizio”.

I danni definiti da Twitter includono denigrazione, stereotipi, misconoscimento o sottorappresentazione, ma anche danni reputazionali, psicologici o anche economici.

La piattaforma di social media ha quindi chiesto ai partecipanti di svolgere un mix di ricerca qualitativa e quantitativa e di presentare i loro risultati in un file read-me che descrivesse i loro risultati, insieme a un collegamento GitHub che dimostrasse il danno. Per giudicare la ricerca più convincente, Twitter ha preso in considerazione criteri come il numero di utenti interessati o la probabilità che si verifichi un danno.

Kulynych ha iniziato generando una serie di volti utilizzando un algoritmo di generazione del volto altamente sofisticato, quindi ha leggermente modificato alcune delle caratteristiche del viso, per scoprire cosa avrebbe più probabilmente attirato l'attenzione dell'algoritmo di salienza. Ha finito con una serie di volti che hanno raggiunto tutti la “massima salienza” – e sembravano riflettere determinati standard di bellezza radicati nel modello.

Ad esempio, nel 37% dei casi, l'attenzione dell'algoritmo è stata catturata meglio quando si schiariva la pelle, o quando la si rendeva più calda, più saturata ea più alto contrasto. In un quarto dei casi, la salienza è aumentata rendendo i tratti più stereotipati femminili; mentre il 18% delle volte, i volti più giovani hanno ottenuto un raccolto migliore. La stessa statistica applicata ai volti più snelli.

In altre parole, le caratteristiche del viso che non sono conformi a determinati standard di “bellezza” impostati dall'algoritmo di Twitter hanno meno probabilità di ottenere l'attenzione quando le immagini vengono ritagliate.

Naturalmente, la rapida inversione di tendenza significa che l'esperimento non è rigoroso come uno studio accademico completo, una lezione appresa per le sfide future. “Per le aziende future che fanno questo, penso che sarebbe necessario più tempo per mettere insieme una presentazione di qualità”, afferma Kulynych.

Twitter stesso ha riconosciuto che questo è solo un primo passo. Quando ha annunciato la sfida, il product manager dell'azienda Jutta Williams ha affermato che l'iniziativa è arrivata con alcune incognite e che le conoscenze sarebbero state applicate per il prossimo evento.

VEDERE: Computer quantistici più grandi, più veloci: questa nuova idea potrebbe essere la via più rapida per le app del mondo reale

Distorsione algoritmica le taglie stanno apparentemente diventando reali, quindi, e i ricercatori possono solo sperare che altre aziende tecnologiche seguano l'esempio, ma con alcuni avvertimenti, afferma Kulynych.

“Non intendo sminuire i risultati della squadra, questa competizione è un enorme passo avanti”, spiega Kulynych. “E il problema del pregiudizio algoritmico è molto importante da affrontare. Penso che le aziende siano incentivate a risolvere questo problema, il che è positivo. Ma il pericolo qui è dimenticare tutto il resto”.

Cioè, se l'algoritmo dovrebbe esistere del tutto. È stato scoperto che alcuni modelli generano danni significativi, sia perché diffondono disinformazione o influiscono sulla privacy. In questi casi, la domanda non dovrebbe essere scoprire come riparare l'algoritmo, ma se l'algoritmo perpetua il danno semplicemente esistendo.

Twitter ha inquadrato la sua sfida algoritmica alla taglia del pregiudizio attraverso il prisma dei “danni” piuttosto che dei “pregiudizi”; ma man mano che il concetto cresce, Kulynych prevede la possibilità che alcune aziende si nascondano dietro la facciata di una taglia di parzialità per legittimare l'esistenza di algoritmi che, per progettazione, sono dannosi.

Ad esempio, anche se un sistema di riconoscimento facciale dovrebbe essere completamente imparziale, non esclude la questione se la tecnologia rappresenti un rischio per la privacy di coloro che ne sono soggetti.

“La cosa più importante del pregiudizio è che presuppone che il sistema debba esistere, e se si corregge solo il pregiudizio, allora tutto nel sistema andrà bene”, afferma Kulynych. “Questa non è una cosa nuova: tutti hanno fatto il lavaggio dell'etica e dell'equità per un po' di tempo”.

I premi sui pregiudizi algoritmici sono stati teorizzati come un metodo che potrebbe servire coloro che sono più colpiti da danni algoritmici discriminatori e potrebbero essere un potente strumento per rendere la tecnologia più equa, a condizione che non diventino invece un altro strumento aziendale.

Big Data

Dov'è il launchpad del cloud ibrido di IBM? Sette modi per rendere la tecnologia in tempo reale reale per la tua organizzazione Machine learning all'avanguardia: TinyML sta diventando grande Quali sono le prospettive di Cloudera? McDonald's vuole “democratizzare” il machine learning per tutti gli utenti nelle sue operazioni

Argomenti correlati:

Digital Transformation CXO Internet of Things Innovation Enterprise Software Smart Cities ![]()