![]()

Quando Apple ha annunciato i suoi piani per affrontare il materiale pedopornografico sui suoi sistemi operativi la scorsa settimana, ha affermato che la soglia fissata per la disattivazione dell'account per i falsi positivi sarebbe stata di una su un trilione all'anno.

Alcuni dei meccanismi su come Apple è arrivata a quel numero sono stati rivelati in un documento [PDF] che ha fornito maggiori dettagli sul sistema.

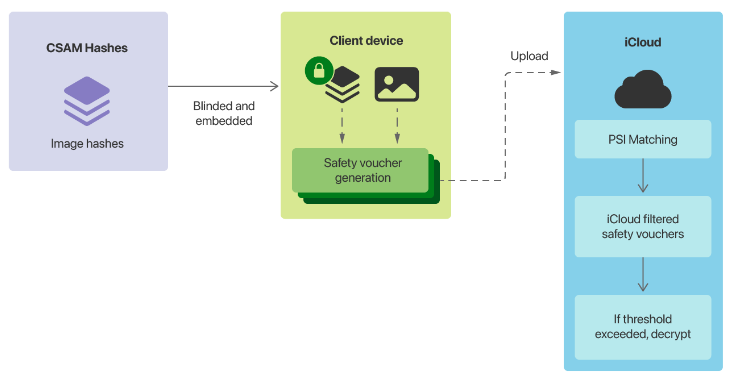

La componente più controversa dei piani di Cupertino era il suo sistema di rilevamento di materiale pedopornografico (CSAM) sul dispositivo. Coinvolgerà i dispositivi Apple che abbinano le immagini sul dispositivo a un elenco di hash di immagini CSAM noti forniti dal National Center for Missing and Exploited Children (NCMEC) degli Stati Uniti e da altre organizzazioni per la sicurezza dei bambini prima che un'immagine venga archiviata in iCloud.

Quando viene raggiunta una soglia di segnalazione, Apple ispezionerà i metadati caricati insieme alle immagini crittografate in iCloud e, se l'azienda determina che si tratta di CSAM, l'account dell'utente verrà disabilitato e il contenuto consegnato a NCMEC negli Stati Uniti.

Il documento afferma che gli hash CSAM utilizzati da Apple sarebbero l'intersezione di due raccolte di due organizzazioni per la sicurezza dei bambini che operano in diversi paesi.

“Qualsiasi hash percettivo che appare nel database di una sola organizzazione per la sicurezza dei bambini partecipante, o solo nei database di più agenzie in un'unica giurisdizione sovrana, viene scartato da questo processo e non viene incluso nel database CSAM crittografato che Apple include nel sistema operativo”, afferma il documento.

Dopo aver eseguito gli hash su 100 milioni di immagini non CSAM, Apple ha trovato tre falsi positivi e zero quando eseguito su una raccolta di pornografia per adulti. La società ha affermato che ipotizzando un tasso di errore nel “caso peggiore” di uno su un milione, desiderava una soglia di segnalazione per garantire la soglia di disabilitazione di falsi positivi di un trilione.

“Costruire un ulteriore margine di sicurezza presumendo che ogni libreria di foto di iCloud sia più grande di quella effettiva più grande, ci aspettiamo di scegliere una soglia di corrispondenza iniziale di 30 immagini”, ha affermato.

“Poiché questa soglia iniziale contiene un drastico margine di sicurezza che riflette un'ipotesi peggiore sulle prestazioni del mondo reale, potremmo modificare la soglia dopo una valutazione empirica continua dei tassi di falsi positivi di NeuralHash, ma la soglia di corrispondenza non sarà mai inferiore a quella che è necessario per produrre un tasso di falsi positivi di un trilione su un dato account”.

Per garantire che i server iCloud di Apple non mantengano un conteggio del numero di immagini CSAM positive di un utente, il loro dispositivo produrrà anche metadati falsi, che Apple chiama voucher di sicurezza. Apple ha affermato che i suoi server non saranno in grado di distinguere i buoni reali da quelli falsi fino al raggiungimento della soglia.

“Il processo di abbinamento sul dispositivo, con una certa probabilità, sostituirà un vero e proprio voucher di sicurezza che viene generato con un voucher sintetico che contiene solo rumore. Questa probabilità è calibrata per garantire che il numero totale di voucher sintetici sia proporzionale alla soglia di abbinamento, ” ha dichiarato Apple.

“Fondamentalmente, questi voucher sintetici sono una proprietà di ciascun account, non del sistema nel suo insieme. Per gli account al di sotto della soglia di corrispondenza, solo il dispositivo dell'utente sa quali voucher sono sintetici; i server di Apple no e non può determinare questo numero e quindi non può contare il numero di corrispondenze vere positive.”

Apple ha anche confermato che i metadati conterranno una copia a bassa risoluzione delle immagini per l'ispezione umana, e queste copie vengono anche eseguite contro gli hash CSAM.

“Questo hash indipendente è stato scelto per rifiutare l'improbabile possibilità che la soglia di corrispondenza sia stata superata a causa di immagini non CSAM che sono state alterate in modo contraddittorio per causare false corrispondenze NeuralHash contro il database CSAM crittografato sul dispositivo”, Apple disse.

“Se la scoperta di CSAM è confermata da questo hash indipendente, i derivati visivi vengono forniti ai revisori umani di Apple per la conferma finale”.

Cupertino ha affermato che il sistema è stato progettato in modo che un utente non debba fidarsi di Apple per sapere che il sistema “funziona come pubblicizzato”.

“Il modello di minaccia si basa sulle proprietà tecniche del sistema per proteggersi dall'improbabile possibilità di revisori malevoli o costretti e, a sua volta, si basa sui revisori per proteggersi dalla possibilità di errori tecnici o umani nelle prime fasi del sistema”, ha affermato Apple.

La società ha sostenuto che il processo di ispezione umana avrebbe assicurato che se gli hash non CSAM fossero stati aggiunti al set di rapporti, il materiale non sarebbe passato da Apple.

“I revisori stanno confermando solo una cosa: che per un account che ha superato la soglia di corrispondenza, le immagini con corrispondenza positiva hanno derivati visivi che sono CSAM”, ha affermato.

“Ciò significa che se immagini non CSAM fossero mai inserite nel database di hash CSAM percettivo sul dispositivo, inavvertitamente o attraverso la coercizione, non ci sarebbe alcun effetto a meno che i revisori umani di Apple non fossero informati anche su quali immagini specifiche non CSAM dovrebbero flag (per gli account che superano la soglia di corrispondenza) e sono stati quindi costretti a farlo.”

La società ha ribadito che rifiuterà le richieste di aggiungere immagini non CSAM al set di dati.

“Apple rifiuterà anche tutte le richieste di istruire i revisori umani a presentare rapporti per qualsiasi cosa diversa dai materiali CSAM per gli account che superano la soglia di corrispondenza”, ha affermato.

Quando ha fatto l'annuncio iniziale, Apple ha anche annunciato che l'apprendimento automatico sarebbe stato utilizzato all'interno di iMessage per avvisare i genitori che utilizzano la condivisione familiare quando gli account dei bambini hanno visualizzato o inviato immagini sessualmente esplicite, oltre a fornire avvisi al bambino.

“Per gli account per bambini di età pari o inferiore a 12 anni, ogni istanza di un'immagine sessualmente esplicita inviata o ricevuta avviserà il bambino che se continua a visualizzare o inviare l'immagine, ai genitori verrà inviata una notifica. Solo se il bambino procede con l'invio o visualizzando un'immagine dopo questo avviso verrà inviata la notifica”, ha affermato in precedenza Apple.

“Per gli account per bambini di età compresa tra 13 e 17 anni, il bambino viene comunque avvisato e gli viene chiesto se desidera visualizzare o condividere un'immagine sessualmente esplicita, ma i genitori non vengono avvisati”.

Nel suo documento, Apple ha affermato che la funzione non può essere abilitata per gli account per adulti e non è abilitata per impostazione predefinita.

Sulla questione dei falsi positivi, ha affermato che nel caso di bambini di età compresa tra 13 e 17 anni, se un'immagine viene categorizzata erroneamente e un bambino la visualizza, vedrebbe qualcosa di non esplicito. Per i minori di 13 anni, potrebbe comportare l'ispezione dei genitori.

“Per un bambino di età inferiore ai 13 anni il cui account ha aderito alla funzione e i cui genitori hanno scelto di ricevere notifiche per la funzione, inviare al bambino un'immagine contraddittoria o una che attiva benignamente una classificazione di falso positivo significa che, se decide per procedere con entrambi gli avvertimenti, vedranno qualcosa che non è sessualmente esplicito e verrà inviata una notifica ai loro genitori”, ha affermato Apple.

“Poiché la foto che ha attivato la notifica è conservata sul dispositivo del bambino, i genitori possono confermare che l'immagine non era sessualmente esplicita”.

Apple ha anche affermato di aver preso in considerazione il problema di un adulto costretto ad accedere a un account da bambino di età inferiore ai 13 anni, ma non ha fornito una risoluzione se non quella di affermare che la mancata visualizzazione delle immagini non avrebbe comportato l'invio di avvisi .

“Se la funzione è stata abilitata surrettiziamente o maliziosamente, ad esempio nel modello di minaccia Intimate Partner Surveillance, costringendo un utente a unirsi a Family Sharing con un account configurato come appartenente a un bambino di età inferiore ai 13 anni, l'utente riceverebbe un avviso quando si tenta di visualizzare o inviare un'immagine sessualmente esplicita”, ha affermato.

“Se scegliessero di procedere, riceverebbero un secondo avvertimento per informarli che la visualizzazione dell'immagine comporterà l'invio di una notifica e per dare loro un'altra scelta se procedere. Se si rifiutassero di procedere, né il fatto che il sono stati presentati avvisi, né la decisione dell'utente di annullare, viene inviata a nessuno.”

Copertura correlata

La scansione di materiale pedopornografico di Apple in iOS 15 attira l'attenzioneApple rifiuta le richieste del governo di espandere la scansione oltre gli abusi sui minoriIntrodotto un disegno di legge statunitense per frenare il “bullismo tecnologico” nello spazio dell'app storeI ricercatori scoprono un nuovo AdLoad campagne di malware rivolte a Mac e prodotti Apple

Argomenti correlati:

Data Center CXO di gestione dei dati di Apple Security TV ![]()